Künstliche Intelligenz verändert unsere Welt in einem atemberaubenden Tempo. Von medizinischen Diagnosen bis hin zu Kreditentscheidungen, von der Personalauswahl bis zur Strafverfolgung – KI-Systeme treffen heute Entscheidungen, die das Leben von Millionen Menschen direkt beeinflussen. Doch wie viel Vertrauen ist tatsächlich gerechtfertigt? Und was braucht es, damit KI wirklich vertrauenswürdig wird?

Was bedeutet „Vertrauenswürdige KI“ eigentlich?

Der Begriff klingt zunächst simpel. Im alltäglichen Sprachgebrauch meint „vertrauenswürdig“ jemanden oder etwas, auf das man sich verlassen kann – jemanden, der gut, ehrlich und aufrichtig ist. Doch bei KI-Systemen steckt weitaus mehr dahinter.

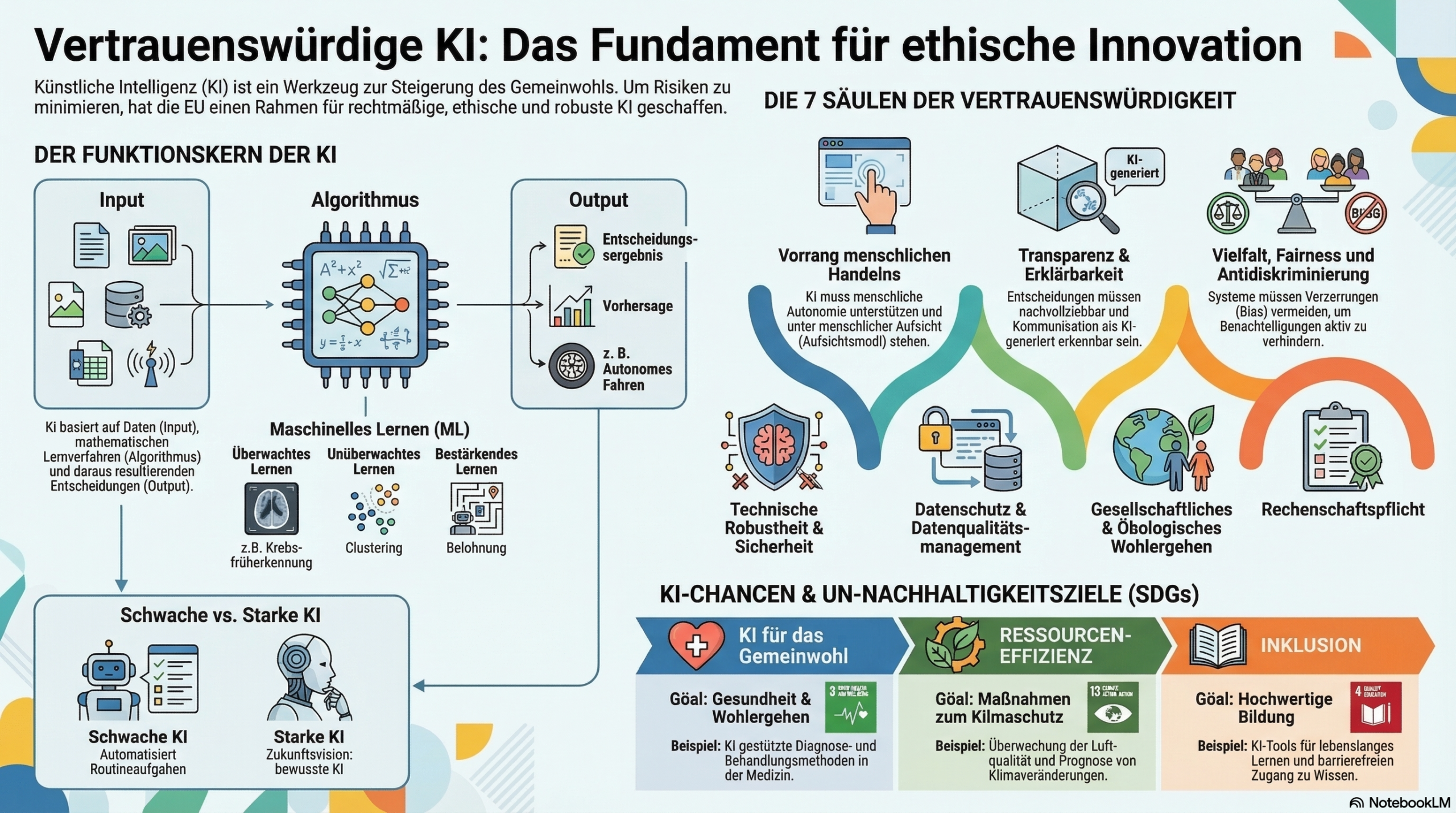

Eine vertrauenswürdige KI muss laut den Ethik-Leitlinien der EU-Expertengruppe (HLEG-KI) drei Kernkomponenten gleichzeitig erfüllen:

- Rechtmäßigkeit – Das System hält alle geltenden europäischen und nationalen Gesetze ein.

- Ethisches Handeln – Ethische Grundsätze und Werte werden aktiv garantiert.

- Robustheit – Das System ist technisch und sozial stabil, auch wenn es unbeabsichtigten Schaden anrichten könnte.

Nur wenn alle drei Komponenten gemeinsam erfüllt sind, kann von einer wirklich vertrauenswürdigen KI gesprochen werden. Das klingt einfach – ist es aber nicht.

Die 7 Minimalanforderungen – das Herzstück vertrauenswürdiger KI

Die EU-Hochrangige Expertengruppe für KI (HLEG-KI) hat sieben Anforderungen definiert, die jedes KI-System mindestens erfüllen muss. Diese Anforderungen sind gleichrangig, unterstützen sich gegenseitig und müssen über den gesamten Lebenszyklus eines Systems gewährleistet bleiben:

1. Vorrang menschlichen Handelns und Aufsicht

KI-Systeme dürfen die menschliche Entscheidungsfreiheit niemals aushöhlen. Nutzer müssen stets in der Lage sein, KI-Empfehlungen kritisch zu hinterfragen, zu verstehen und notfalls abzulehnen. Menschliche Autonomie hat immer Vorrang.

2. Technische Robustheit und Sicherheit

Ein KI-System muss widerstandsfähig gegen Angriffe, Datenverlust und unvorhergesehene Fehler sein. Sicherheitspläne, Genauigkeit und Reproduzierbarkeit der Ergebnisse sind zentrale Qualitätskriterien.

3. Datenschutz und Datenqualität

Privatsphäre schützen, Datenqualität sichern, DSGVO einhalten – und das nicht nur auf dem Papier. KI-Systeme dürfen nicht auf Basis veralteter, unvollständiger oder voreingenommener Daten trainiert werden.

4. Transparenz

Wie funktioniert das System? Auf Basis welcher Daten und Regeln trifft es Entscheidungen? Nutzer und Betroffene müssen Antworten auf diese Fragen bekommen können. Erklärbarkeit ist keine Kür, sondern Pflicht.

5. Vielfalt, Nichtdiskriminierung und Fairness

KI-Systeme dürfen keine bestehenden gesellschaftlichen Ungleichheiten reproduzieren oder verstärken. Besonders kritisch: Algorithmen, die bei Bewerbungsverfahren, Kreditvergaben oder Polizeimaßnahmen eingesetzt werden.

6. Gesellschaftliches und ökologisches Wohlergehen

KI muss dem Gemeinwohl dienen – nicht nur den Interessen einzelner Unternehmen. Auch ökologische Nachhaltigkeit und demokratische Grundwerte müssen berücksichtigt werden.

7. Rechenschaftspflicht

Wenn etwas schiefläuft, muss Verantwortung klar zuordenbar sein. Rückverfolgbarkeit, Risikobewertungen und Rechtsmittel für Betroffene sind unverzichtbar.

Warum das alles schwieriger ist, als es klingt

Die größte Herausforderung liegt in der Definition von Ethik und Fairness – denn diese Begriffe sind kulturell und subjektiv geprägt. Was in einer Gesellschaft als fair gilt, kann in einer anderen als ungerecht wahrgenommen werden. Noch komplizierter: Individuelle Fairness kann in direktem Widerspruch zu kollektiver Gerechtigkeit stehen.

Ein Beispiel: Ein Algorithmus, der für jede einzelne Person statistisch „fair“ urteilt, kann für bestimmte Gruppen systematisch benachteiligend sein – das ist das klassische Problem des Algorithmic Bias. Forscher der Universitäten Virginia und Washington haben dieses Phänomen etwa beim sogenannten Gender Bias in Bilderkennungssystemen nachgewiesen.

Der Weg von der Theorie zur Praxis: ALTAI und der AI Act

Die EU hat mit dem ALTAI (Assessment List for Trustworthy AI) ein praktisches Werkzeug geschaffen: eine detaillierte Checkliste, mit der Unternehmen und Entwickler ihre KI-Systeme selbst bewerten können. Sie hilft dabei, konkrete Schwachstellen zu identifizieren und ethische Reflexion in den Entwicklungsprozess zu integrieren.

Ergänzt wird das durch den EU AI Act, der KI-Systeme nach Risikoklassen reguliert – von „minimales Risiko“ bis „inakzeptables Risiko“ (z. B. Social Scoring oder manipulative KI-Systeme, die explizit verboten sind).

Fazit: Vertrauen muss verdient werden

Regulierungen und Zertifizierungen sind wichtige Schritte – aber kein Freifahrtschein. Vertrauenswürdige KI erfordert auch in Zukunft menschliche Wachsamkeit, kontinuierliche ethische Reflexion und eine offene gesellschaftliche Debatte darüber, welche Werte wir in unsere Technologien einschreiben wollen.

Die Frage „Welcher KI können wir vertrauen?“ führt letztlich zur tieferen Frage: „Was ist gerecht?“ – und diese Frage ist nicht technischer, sondern zutiefst menschlicher Natur.